En el momento de la inteligencia artificial generativa (Genai), la frase “Creo que cuando lo veo” ya no se encuentra. Genai no solo puede crear representaciones de personas manipuladas, sino que también puede usarse para generar personas y escenarios totalmente ficticios.

A Lire Aussi: El uso de defectos profundos puede ser dimensionado por la duda, creando confusión y desconfianza en los espectadores

Como investigador de informática y candidato a doctorado en la Universidad de Waterloo, todo está más involucrado en su propia incompetencia para discernir lo que realmente es de lo que es en general.

Mi equipo de investigación realizó una encuesta en la que se solicitó a casi 300 participantes que clasificaran un conjunto de imágenes de Real o Falso. La precisión promedio de la clasificación de los participantes fue del 61 por ciento en 2022. Años. Es más probable que los participantes clasifiquen las imágenes reales correctamente que las falsificaciones. Es probable que la precisión sea mucho menor hoy gracias a la mejora rápida de la tecnología Genai.

También analizamos sus respuestas utilizando texto minero y extraer palabras clave para aprender las justificaciones habituales de que los participantes reciben sus clasificaciones. Fue inmediatamente obvio que, en la formación de la imagen, las personas se consideraron un indicador de revelador de que la imagen probablemente se generó. AI también luchó por producir dientes, orejas y cabello reales.

Pero estas herramientas están mejorando constantemente. Los signos de RealTal que solíamos usar para detectar y las imágenes resultantes ya no son confiables.

Mejora de la imagen

Los investigadores comenzaron a explorar el uso de Gans para la síntesis de imágenes y videos en 2014. Años. El documento del seminario “Red de oponente generativo” introdujo el proceso de GANS del oponente. Aunque este trabajo no menciona a DeepFakes, fue un trampolín para Deepfakes basados en GaN.

Algunos ejemplos tempranos de arte Genai utilizado por Gans incluyen imágenes de “Deepdream” creado por el ingeniero de Google Alexander Mordvintsev en 2015 años.

Pero 2017, el término “Deepfake” nació oficialmente después del usuario rojo, cuyo nombre de usuario era “Deepfakes”, usó Gans para generar pornografía sintética de celebridades.

Ioshua Bengio (derecha), cuyo obras era un proyecto de ley profundo basado en primavera, basado en GaN “, se encontró en los riesgos y peligros potenciales de la IA generada. Impresión canadiense / Ryan Remorz

En 2019, el software Philip Wang fue creado por el sitio web “ThisPersondoeskist”, que utilizó Gans para generar imágenes reales de personas. En el mismo año, el lanzamiento de Deepfake Detection Detection, que solicitó modelos de detección de Deepfake nuevos y mejorados, prestó mucha atención y condujo al aumento de los profundos.

A Lire Aussi: Cómo combatir el uso poco ético y costoso de los deffakes

Aproximadamente décadas más tarde, uno de los autores del documento “Red de material generativo” “Ioshua Bengio, comenzó a compartir preocupaciones debido a la necesidad de regular la IA debido a los peligros potenciales, dicha tecnología puede establecer la humanidad.

Bengio y otros y trailblazers firmaron la carta abierta en 2024. Años, invitando a una mejor regulación de Deepfake. También dirigió el primer informe de seguridad internacional de IA, que se publicó a principios de 2025. años.

Hao Li, Deepfake Pioneer y uno de los mejores artistas del mundo, admitió una forma que recuerda a la famosa cita de Robert Oppenheimer “I Buin Meed Death”:

“Esto es más acelerado desarrollando más de lo que pensé. Pronto llegará al punto en que no hay forma de que no podamos encontrar” defectos profundos “, por lo que debemos ver otros tipos de soluciones”.

Nueva información errónea

Las grandes compañías técnicas realmente alentaron el desarrollo de algoritmos que pueden revelar Deepfakes. Estos algoritmos generalmente buscan los siguientes caracteres para determinar si el contenido de Deepfake es:

El número de palabras de la oración, o la velocidad de habla (la tasa promedio de los ojos humanos, las cejas, la nariz, los labios, los dientes, que es de manera convincente (hay una imagen de saturación más baja y que tienen menos imágenes saturadas. En comparación con las imágenes tomadas por la cámara HDR.

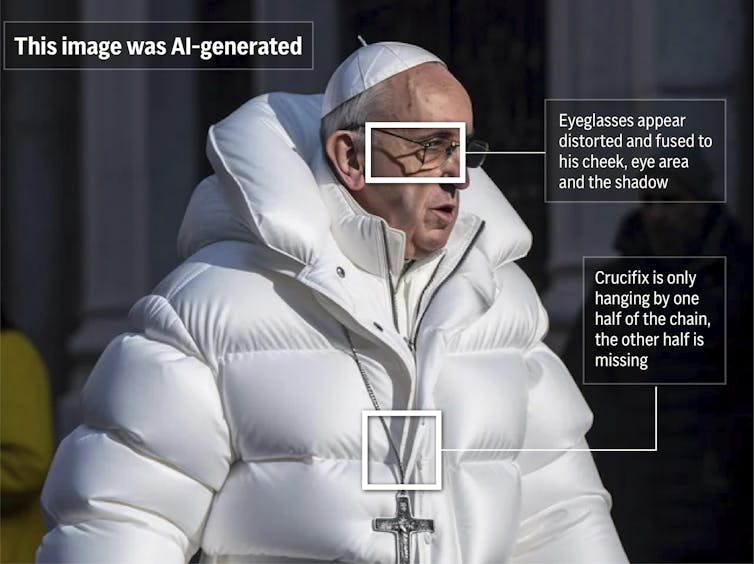

AI Fairers se convierte rápidamente en uno de los mayores problemas que enfrentamos en línea. Con AI Deepfakes, que es casi todos los días, como este Papa Francisco, se vuelve más difícil decir lo que realmente es de lo que no es. (Associated Press)

Pero incluso estos algoritmos tradicionales de detección de Deepfake sufren varias deficiencias. Por lo general, están entrenados en imágenes de alta resolución, por lo que pueden no descubrir registros de monitoreo de baja resolución o cuando el sujeto está mal iluminado o planteado de una manera imperdible.

A pesar de los intentos de regulación leves e inadecuados, los jugadores deshonestos todavía usan defectos profundos y el texto de síntesis y imagen a una imagen para fines no exhaustados. Las consecuencias de este uso no regulado van desde la desestabilización política a nivel nacional y global para destruir la reputación causada por ataques muy personales.

La información errónea no es nueva, pero los modos de propagación cambian constantemente. Los defectos profundos se pueden usar no solo para difundir la información errónea, es decir, que algo es falso verdadero, sino también para crear credibilidad de negación y poses que algo verdadero es falso.

Debe decirse que en el mundo de hoy, ver nunca volverá a creer. Lo que una vez podría haber sido una evidencia inusual de que podría ser la imagen de Yalena.

Descubre más desde USA Today

Suscríbete y recibe las últimas entradas en tu correo electrónico.